Občas zkouším A/B testovat manželku Lucku. V době, kdy ještě pila ráno kafe jsem jí ho s láskou připravoval. A dával do něj jeden cukr.

A pak mně začalo vrtat hlavou, ve které chvíli Lucka zjistí, že už je to moc sladké. Takže jsem jí každý den dal o jednu kostku cukru navíc. Všimla si toho u devíti kostek, a to, co mi potom řekla si za klobouk rozhodně nedám.

Pokud vám to připomíná příběh o žábě a vařící se vodě, tak máte pravdu. Jen bych rád uvedl na pravou míru fámu, že se žába uvaří. Studovali to od 19. století a naposledy se tím zabývali v roce 1995 na Harvardu.

Co se zjistilo:

- pokud žábě vyndáte mozek, tak se uvaří,

- pokud žábu hodíte do vařící vody, tak se taky uvaří,

- pokud žábu necháte ve studené vodě a tu ohříváte, tak jí to přestane po chvíli bavit a vyskočí ven.

A když už jsme u těch zvířátek, tak angličani mají hezké přísloví: „There are more ways to skin a cat.“ – Je více způsobů, jak stáhnout kočku. A více způsobů, jak spustit A/B test. Nejdřív je ale potřeba zjistit:

Kdy má smysl A/B testovat

Je pár nutných předpokladů, než vůbec můžete uvažovat a A/B testování:

- Máte vyšší stovky či spíš tisíce konverzí (objednávek, vyplnění formuláře atd.)

Tohle je nutné kvůli tomu, abyste dosáhli rozumné statistické jistoty. Překvapivě až tolik nezávisí na návštěvnosti. - Máte nápady na A/B testování opřené o data za UX/CRO analýzy.

Bez analýzy budete testovat blbosti a úspěšnost budete mít cca 1 ku 7. Což znamená, že dříve či později váš šéf nebo klient vybublá, protože se mu nevyplatíte. - Máte střední jistotou, jaký efekt daná změna bude mít.

Pokud máte velkou jistotu, že daná změna bude k lepšímu (nebo horšímu), tak ji nemá cenu testovat. Rovnou ji (ne)nasaďte a případně zkontrolujte B/A (before and after) testem. Pokud máte malou jistotu, a test jste si vycucali z prstu, tak potřebujete víc dat a pořádnou hypotézu. No a pokud máte střední jistotu, tak to otestujte. - Test vám poběží 1-8 týdnů

Pokud vám test bude po 3 dnech říkat, že už je „upečený“ a dosáhl statistické jistoty 95 %, tak mu nevěřte. Minimální čas běhu testu je týden, lépe dva. Maximum kvůli tzv. sample polution jsou dva měsíce. Minulý týden jsem řešil test, který po třech dnech vypadal tragicky (-15 % obratu, jistota 95 %) a po týdnu to klientovi vydělávalo 4 000 Kč denně navíc.

Pokud všechno tohle splňujete, tak se můžeme pustit do práce.

Je více způsobů, jak spustit A/B test

A teď prosím všechny statistiky, aby tenhle článek zavřeli, protože se tu nebude hrát podle pravidel. Jedna věc je totiž statistika, čisté zadání, testování jen jedné věci, nesouběžné testy – ale to žijeme v ideálním světě. A já jsem praktik, co četl Machiavelliho Vladaře. A pro mě byznysový účel světí prostředky.

1. Počet změn v 1 variantě

Můžete testovat jen jednu změnu, nebo změn více najednou.

Jedna změna:

Testování jedné změny má výhodu v tom, že si ověříte hypotézu. Například: Má skrytí formulářového pole vliv na dokončení objednávky a obrat? Nevýhoda je v tom, že test často trvá déle, zvlášť, pokud chcete testovat víc věcí. Na druhou stranu poučení s testu jste schopni lépe aplikovat jinde.

Více změn:

Testování více změn – pokud je máte opřené o analýzu, data a předchozí testy – má potenciálně výhodu v tom, že dospějete k výsledku dřív a přínos bude vyšší. Nevýhoda je v tom, že nezjistíte, která změna jak moc pomohla. Případně zda nějaká neubližuje. Často ale na základě výsledku tohoto testu spouštíme další, který už jde víc do detailu.

Příklad:

Vezměte si typický příklad. Udělali jste si analýzu stránky a vypadlo vám z toho 10 změn. U 4 z nich máte relativně velkou jistotu (například na základě předchozích A/B testů), že povedou ke zlepšení. A u zbytku si nejste jistí. Co uděláte?

Já bych 4 změny nasadil rovnou a zbytek zakomponoval do varianty B. Navíc vzal všechny změny a udělal variantu C. Je to čisté? Není. Ale je to efektivní. Protože alternativa je otestovat každou změnu samostatně, což při průměrné délce testu 28 dní znamená, že budete testovat 9 měsíců v kuse. Místo jednoho.

Samozřejmě pokud testujete změny, které můžou celý byznys potopit – jako úpravy košíku, tak tam je opatrnost na místě.

2. Počet variant

0 variant

Změny prostě nasadíte a poměřujete před a po.

1 stejná varianta

Testujete variantu A oproti variantě A. Pokud jste se právě začali drbat na hlavě, tak tohle děláte proto, abyste si ověřili, zda dobře funguje testovací nástroj. Neměli byste dospět k tomu, že jedna (stejná) varianta je statisticky lepší než druhá.

1 varianta

Testováním jen jedné varianty dospějete ke statistické jistotě dřív.

Více variant

Doporučuji netestovat víc než 3-4 varianty. Jednak se vám s počtem variant zvyšuje délka testu, jednak šance, že vyberete špatnou variantu (false positive/negative). Musíte dosáhnout větší statistické jistoty, než 95 % kvůli Bonferroniho korekci. Viz sekce nebezpečí na konci článku.

Nicméně já mám testování více variant rád, protože si můžu kopnout balón dál od nohy. A špatně performující varianty můžu v průběhu testu vypnout – je ale dobré mít předem daná pravidla, za jakých podmínek vypínat, protože i špatná varianta může v průběhu času vyhrát.

3. Intenzita změny

Máte jeden nápad na změnu, například změna primárního tlačítka. A můžete zkusit malý, střední a velký kontrast. A zjistit efekt. Nebo zkusíte přidat ohlasy zákazníků. 1, 5, nebo 50.

Výhoda je v tom, že testujete vlastně jednu věc, takže máte hypotézu a poučení, a zároveň testujete intenzitu dané varianty. Může se totiž stát, že pokud otestujete jen malou intenzitu změny, že výsledek bude šulnul. A vy tak mylně dospějete k názoru, že daná změna nemá žádný vliv. Část změn se projeví jen při určité intenzitě.

4. Typ změny

Můžeme do stránky nebo na web něco:

- přidat

Například lištu s výhodami. - ubrat

Například políčko se slevou. - vyměnit

Například tlačítko koupit.

U přidání a ubrání je efekt poměrně jasný. U výměny se může stát, že budeme měnit dobře fungující věc za špatně fungující věc. Od toho testujeme.

5. Blízkost konverze

Já vždycky říkám, testujte co nejblíže penězům. Protože budete mít rychle výsledky. Ať už pozitivní nebo negativní.

U testu je vždycky dobré si říct, která metrika je důležitá, a která podpůrná. Ale hlavně jich mít víc. Protože se často ukazuje, že například přidání do košíku je méně, ale obratu více.

Metriky seřazené podle důležitosti jsou:

- zisk (špatně se měří)

- obrat

- počet objednávek

- počet kusů zboží

- průměrná hodnota objednávky

- přidání do košíku

- navštívení další stránky

- kliknutí na tlačítko

- bounce rate, exit rate, čas na stránce, engagement – tohle můžete většinou ignorovat

My jsme nedávno testovali získání úvěru na produktové stránce, a před uživatelem bylo 8 dalších stránek než došlo ke konverzi. Bylo téměř jisté, že nedojdeme s touto metrikou do statistické jistoty. Takže jsme brali sekundární metriky jako: kolik lidí zažádalo o úvěr, kolik lidí si úvěr spočítalo v kalkulačce a kolik lidí kliklo na tlačítko Spočítat úvěr.

Jen pozor, tyto „mělké“ metriky (kliknutí na Koupit) nemusí mít kýžený dopad (obrat).

6. Rozsah testu

Můžete testovat jen jednu stránku, více stránek, nebo stránky všechny.

- jednu stránku – například homepage nebo vstupní stránku

- více stránek – například košík nebo všechny stránky s detailem produktu

- všechny stránky – například změnu navigace, pruhu s výhodami.

Čím více stránek, tím rychlejší výsledek. Pokud například testujete všechny stránky produktu, tak si můžete dovolit víc variant.

7. Minimální změna a citlivost testu

Před každým testem je potřeba odhadnout zlepšení a díky tomu minimální počet návštěv. Abyste zjistili délku testu. Může se totiž ukázat, že budete testovat dva roky, a pak ten test ani nezačínejte.

Čím větší potenciální zlepšení, tím méně potřebujete návštěv a tím kratší bude test. Nebo můžete udělat víc variant.

Pokud naopak míříte na 1% zlepšení (s dostatečnou jistotou), tak good luck. Pokud nejste Amazon nebo Booking. Já věštinou mířím na minimálně 5 % navíc, protože méně než to je problematické kvůli vnějším vlivům a délce testu.

8. Cílové publikum

Je dobré si taky říct, komu test ukážete. Já až na výjimky doporučuji testovat zvlášť desktop a zvlášť mobil. Protože lidi se na těchto zařízeních chovají diametrálně odlišně.

Cílení na specifické zákazníky má tu výhodu, že jim můžete říct konkrétnější věc, než když mluvíte ke všem. Typické dělení je na:

- zákazník a nezákazník

- přihlášený a nepřihlášený uživatel (registrovaný, příjemce newsletteru)

- nový vs vracející se

- přicházející z konkrétní stránky nebo kampaně

- prohlížeč, operační systém, … se specifickou cookie

Jen pozor, abyste si dobře spočetli délku testu, protože si tu omezujete množství uživatelů v testu. A dvojitý pozor, pokud si zákazníky budete ex-post segmentovat v analytice, protože se můžete dívat na segment o 5 uživatelích.

Nebezpečí

Příliš variant aneb 41 odstínů šedé modré

V roce 2009 se v Googlu nemohli shodnout na modré barvě tlačítka. Tak udělali 41 (!) variant a spustili A/B/n test.

Mělo to zajímavé výsledky:

- Jejich hlavní designér Doug Bowman řekl, že na tohle jim sere a dal výpověď. A napsal rozlučkový článek.

- S 95% jistotou vybrali modrou, ale neuvědomili si, že je 87,8% šance, že vyberou špatně.

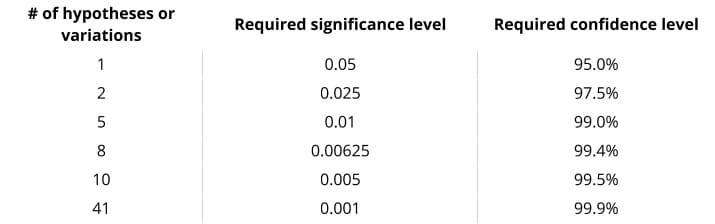

Čím více variant testujete, tím je větší šance na výběr špatné varianty. Existuje proto tzv. Bonferroniho korekce.

Nechci zabíhat do detailů, stačí vám tato tabulka:

Šance, že vyberete špatnou varianty při 95% jistotě (p-value 0,05):

A tady tabulka, na jakou jistotu mířit při počtu variant:

Peaking rule

Další, čeho byste se měli vyvarovat je se příliš často dívat na výsledky. Mluvil o tom Lukas Redmeer z Bookingu na Marketing Festivalu.

Čím častěji se díváte na průběžné výsledky, tím je větší šance, že to dočasně dosáhne statistické jistoty a vy vyberete špatně. Takže doporučuji se kouknout na začátku, abyste si ověřili správné nastavení testu v rámci QA. A pak v nějakých rozumných intervalech, třeba týden kvůli pravidlům pro zastavení neperformujících variant a pak až na konci testu – který si spočítáte předem.

Pokud si vezmu příklad, kdy máte 2000 uživatelů. V A variantě se podíváte až na konci testu (a míříte na 90% jistotu). Ve B variantě to budete kontrolovat po každé návštěvě. Čímž si zvýšíte šanci zvolit špatně 5násobně (a máte jen 45% jistotu, že zvolíte správně). Zde je k tomu detailní článek.

Pravidla pro zastavení testu

Vřele doporučuji si před testem nastavit pravidla pro zastavení špatně performující varianty. Protože statistika je jedna věc. Ale když máte klienta na telefonu a ptá se vás, proč mu pálíte peníze nešikovnou variantou… to je jiné kafe.

Zastavení testu má vlastně dvě varianty:

- Kdy zastavit test, který nedosahuje statistické jistoty?

- Kdy zastavit špatně performující variantu?

Nejistota

Test spouštíte s tím, že potenciální nárůst odhadujete. Ale může se ukázat, že jste vedle. Respektive je jen otázka času, než se to ukáže :). Pokud koukáte na test druhý týden, a lítá vám to nahoru dolů a jistota je rozmezí -15 až +30, tak je otázka, zda se dál trápit.

Já zastavuji test když:

- Máte naplánované další A/B testy

- Ve třetině délky testu je jistota menší než 25 %.

- V polovině spočítané délky testu je jistota menší než 35 %.

Špatná varianta

Druhá možnost je, že v průběhu testu některá varianta snižuje metriku (například obrat).

Abyste se neunáhlili, tak tady jsou pravidla:

- Máte více než 100 konverzí.

- Varianta vám snižuje metriku o 15 %.

- Máte jistotu 90 %.

Závěr

Chtěl jsem říct, že testování není žádná věda. Ale je. Takže popřeji silné hypotézy, hodně jistoty a krátké testy. A nevěště hlavu, když většina testů nebude pozitivních. Je to úplně normální. I ti nejlepší optimalizátoři mají úspěšnost 30-50 %. A pokud testujete dlouho, a většinu věcí už jste vylepšili, tak jste – jako Amazon a Booking – na jednotkách procent.

Pokud s tím chcete pomoct, dejte vědět na o@ilincev.com.

Zdroje:

https://conversionxl.com/blog/can-you-run-multiple-ab-tests-at-the-same-time/

https://www.widerfunnel.com/3-mistakes-invalidate-ab-test-results/

https://www.analytics-toolkit.com/whitepapers.php?paper=efficient-ab-testing-in-cro-agile-statistical-method

https://goodui.org/blog/the-anatomy-of-an-ab-test/

https://www.evanmiller.org/how-not-to-run-an-ab-test.html

https://www.lucidchart.com/blog/the-fatal-flaw-of-ab-tests-peeking

Smysluplná debata